A Era Computacional: da Limitação Técnica à Multiplicidade de Sistemas

Tempo de Leitura: 12 a 15 minutos

Se, ao longo do século XX, a romanização do sânscrito passou a oscilar entre a precisão filológica e a acessibilidade prática, a segunda metade desse período introduz uma variável que altera profundamente a natureza do problema: a tecnologia. A partir do surgimento dos computadores e da digitalização progressiva da informação, a questão da transliteração deixa de ser apenas linguística, pedagógica ou cultural e passa a ser também técnica, vinculada às limitações e possibilidades dos sistemas de codificação de caracteres.

Nesse novo cenário, a escrita deixa de estar restrita ao papel e às edições impressas e passa a ser mediada por sistemas digitais que impõem restrições próprias, muitas vezes alheias às exigências da linguagem. O padrão ASCII, desenvolvido na década de 1960 como base para a troca de informações entre computadores, ilustra de forma clara essa limitação (CERF; KAHN, 1974; ISO, 1967). Com um conjunto reduzido de caracteres, restrito essencialmente ao alfabeto latino básico, o ASCII não prevê a utilização de sinais diacríticos, tornando impraticável o uso direto de sistemas como o IAST em ambientes digitais iniciais. A impossibilidade de representar vogais longas por mácron ou consoantes retroflexas por pontos subescritos não é apenas um detalhe técnico, mas um obstáculo estrutural à preservação das distinções fonéticas fundamentais do sânscrito.

Diante dessa limitação, a romanização do sânscrito entra em uma nova fase, caracterizada não pela busca de um único padrão ideal, mas pela criação de múltiplos sistemas adaptados às exigências computacionais. Diferentemente das soluções desenvolvidas no contexto filológico, que buscavam equilibrar precisão e legibilidade, esses novos esquemas passam a priorizar critérios como facilidade de digitação, compatibilidade com teclados padrão e, sobretudo, a possibilidade de reconversão automática para o dêvanágarí. A transliteração deixa de ser apenas uma representação visual da língua e passa a funcionar como uma forma de codificação (SCHAAFSMA, 1998; GONDA, 1975).

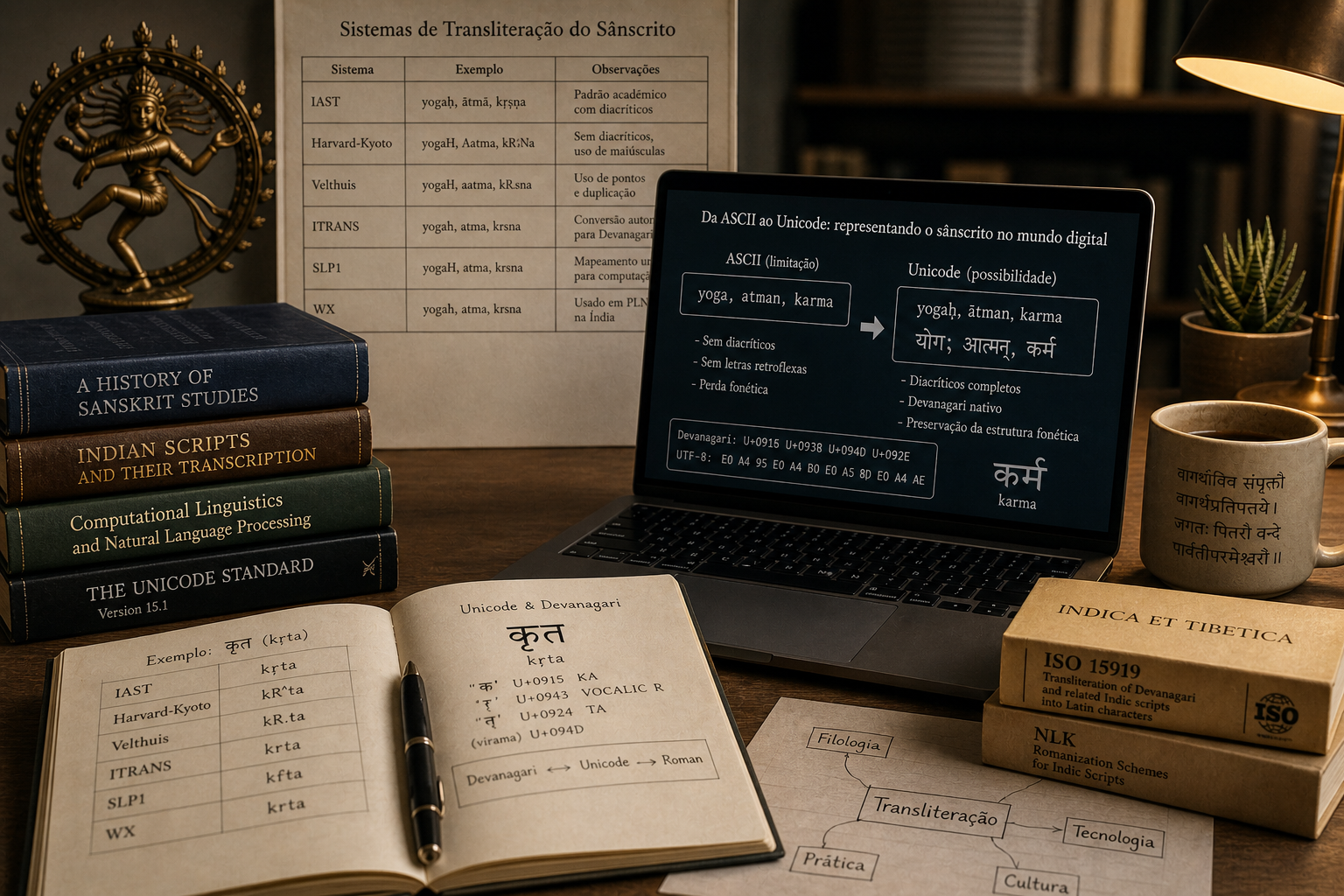

É nesse contexto que surgem sistemas como Harvard-Kyoto, Velthuis, ITRANS, SLP1 e WX notation, cada um deles representando uma resposta específica ao mesmo problema. No sistema Harvard-Kyoto, por exemplo, o comprimento vocálico e as consoantes retroflexas são indicados por letras maiúsculas, como em “A” para ā ou “T” para ṭ, evitando o uso de diacríticos. Já o sistema Velthuis utiliza combinações de caracteres, como “aa” para ā ou “.t” para ṭ, buscando uma correspondência mais explícita entre grafia e som. O ITRANS, por sua vez, introduz uma lógica de conversão bidirecional, permitindo que a transliteração em ASCII seja automaticamente transformada em dêvanágarí, o que o torna particularmente adequado para ambientes digitais e para a produção de textos eletrônicos (AVINASH CHOPDE, 1996).

O sistema SLP1 adota uma abordagem ainda mais radical, estabelecendo uma correspondência unívoca entre cada fonema sânscrito e um único caractere ASCII, o que o torna extremamente eficiente para processamento computacional, embora menos intuitivo para leitura humana. O WX notation, amplamente utilizado na Índia, especialmente em aplicações de processamento de linguagem natural, segue uma lógica semelhante, priorizando a consistência interna e a facilidade de manipulação por algoritmos (BHATTA; PRASAD, 2004). Em todos esses casos, a transliteração deixa de ser pensada prioritariamente para o leitor humano e passa a ser concebida também como interface entre linguagem e máquina.

Essa multiplicidade de sistemas não deve ser interpretada como uma falha de padronização, mas como consequência direta da coexistência de diferentes finalidades. Se, nos períodos anteriores, a romanização oscilava entre o rigor científico e a funcionalidade prática, a era computacional introduz um terceiro polo: a eficiência algorítmica. A precisão fonética, a legibilidade humana e a compatibilidade computacional passam a constituir três dimensões distintas, nem sempre conciliáveis em um único sistema. Cada esquema de transliteração enfatiza uma dessas dimensões, refletindo o contexto em que foi desenvolvido.

Com o advento do Unicode, a partir do final do século XX, essa limitação técnica é, em grande medida, superada. Ao permitir a representação consistente de caracteres com sinais diacríticos e a inclusão de sistemas de escrita não latinos, o Unicode torna possível o uso direto tanto do IAST quanto do próprio dêvanágarí em ambientes digitais (UNICODE CONSORTIUM, 2020). Em princípio, isso poderia sugerir uma convergência em direção a um padrão único, no qual a necessidade de sistemas alternativos desapareceria. No entanto, o que se observa é o contrário: a coexistência desses sistemas não apenas persiste, mas se consolida.

Isso ocorre porque os sistemas desenvolvidos durante a era ASCII não respondem apenas a limitações técnicas contingentes, mas a necessidades estruturais distintas. Mesmo em um ambiente em que o Unicode permite a representação plena dos caracteres, a facilidade de digitação, a compatibilidade com sistemas legados e a eficiência em processamento automático continuam a favorecer o uso de transliterações simplificadas em contextos específicos. A permanência de sistemas como ITRANS e Harvard-Kyoto não é, portanto, um resquício do passado, mas uma adaptação funcional a diferentes modos de uso da linguagem.

Nesse cenário, normas como a ISO 15919 e sistemas como o NLK expandem os princípios do IAST para abranger não apenas o sânscrito, mas outras línguas e escritas do subcontinente indiano, consolidando um modelo de transliteração que busca equilibrar precisão fonética e aplicabilidade internacional (ISO, 2001). Ainda assim, a diversidade de sistemas permanece, refletindo a impossibilidade de reduzir a uma única solução as múltiplas funções que a linguagem desempenha no mundo contemporâneo.

O que a era computacional torna evidente é que a romanização do sânscrito não é um problema que admite solução definitiva. Cada tentativa de padronização resolve um conjunto específico de questões, ao mesmo tempo em que introduz novas limitações em outros contextos. A história da transliteração, vista em seu conjunto, revela um processo contínuo de adaptação, no qual a língua é constantemente reconfigurada para responder às exigências de diferentes ambientes — rituais, acadêmicos, administrativos e, agora, digitais.

Fontes:

AVINASH CHOPDE.

ITRANS: Transliteration Scheme for Indian Languages. 1996.

BHATTA, Krishna; PRASAD, B.

Natural Language Processing: A Paninian Perspective. New Delhi: Prentice-Hall of India, 2004.

CERF, Vinton; KAHN, Robert.

A protocol for packet network intercommunication. IEEE Transactions on Communications, 1974.

GONDA, Jan.

The Indian Mantra. Leiden: Brill, 1975.

ISO.

ISO 646: Information Processing — ISO 7-bit coded character set for information interchange. Geneva: International Organization for Standardization, 1967.

ISO.

ISO 15919: Transliteration of Devanagari and related Indic scripts into Latin characters. Geneva: International Organization for Standardization, 2001.

SCHAAFSMA, Willem.

Indian Scripts in Unicode. 1998.

UNICODE CONSORTIUM.

The Unicode Standard, Version 13.0. Mountain View: Unicode, 2020.