O Desenvolvimento da Transliteração do Sânscrito — Parte IV

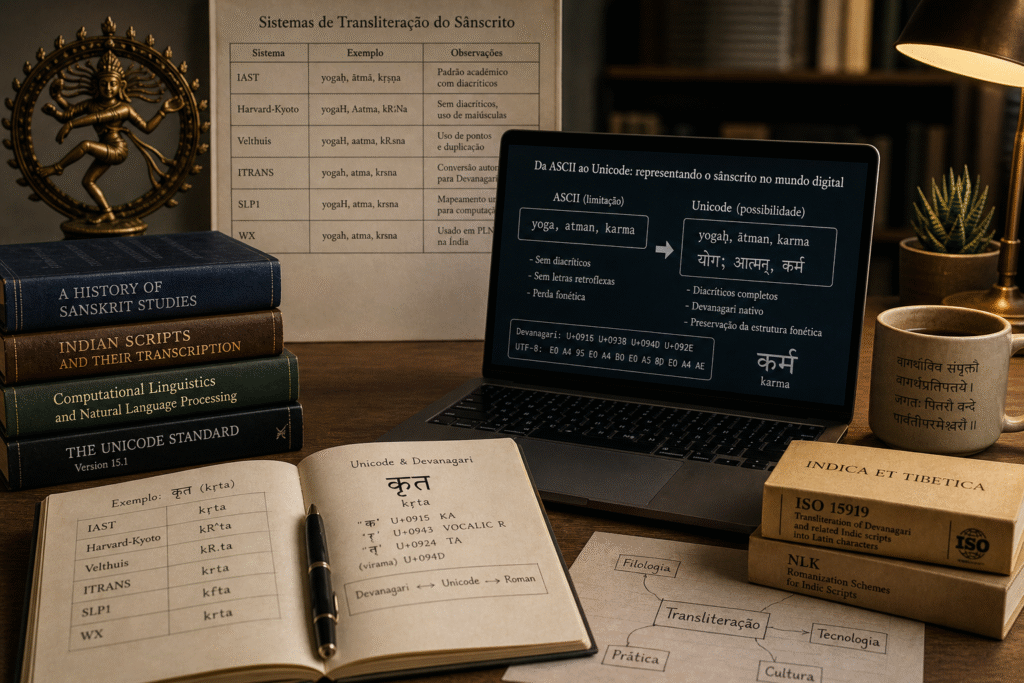

A Era Computacional: da Limitação Técnica à Multiplicidade de Sistemas Tempo de Leitura: 12 a 15 minutos Se, ao longo do século XX, a romanização do sânscrito passou a oscilar entre a precisão filológica e a acessibilidade prática, a segunda metade desse período introduz uma variável que altera profundamente a natureza do problema: a tecnologia. A partir do surgimento dos computadores e da digitalização progressiva da informação, a questão da transliteração deixa de ser apenas linguística, pedagógica ou cultural e passa a ser também técnica, vinculada às limitações e possibilidades dos sistemas de codificação de caracteres. Nesse novo cenário, a escrita deixa de estar restrita ao papel e às edições impressas e passa a ser mediada por sistemas digitais que impõem restrições próprias, muitas vezes alheias às exigências da linguagem. O padrão ASCII, desenvolvido na década de 1960 como base para a troca de informações entre computadores, ilustra de forma clara essa limitação (CERF; KAHN, 1974; ISO, 1967). Com um conjunto reduzido de caracteres, restrito essencialmente ao alfabeto latino básico, o ASCII não prevê a utilização de sinais diacríticos, tornando impraticável o uso direto de sistemas como o IAST em ambientes digitais iniciais. A impossibilidade de representar vogais longas por mácron ou consoantes retroflexas por pontos subescritos não é apenas um detalhe técnico, mas um obstáculo estrutural à preservação das distinções fonéticas fundamentais do sânscrito. Diante dessa limitação, a romanização do sânscrito entra em uma nova fase, caracterizada não pela busca de um único padrão ideal, mas pela criação de múltiplos sistemas adaptados às exigências computacionais. Diferentemente das soluções desenvolvidas no contexto filológico, que buscavam equilibrar precisão e legibilidade, esses novos esquemas passam a priorizar critérios como facilidade de digitação, compatibilidade com teclados padrão e, sobretudo, a possibilidade de reconversão automática para o dêvanágarí. A transliteração deixa de ser apenas uma representação visual da língua e passa a funcionar como uma forma de codificação (SCHAAFSMA, 1998; GONDA, 1975). É nesse contexto que surgem sistemas como Harvard-Kyoto, Velthuis, ITRANS, SLP1 e WX notation, cada um deles representando uma resposta específica ao mesmo problema. No sistema Harvard-Kyoto, por exemplo, o comprimento vocálico e as consoantes retroflexas são indicados por letras maiúsculas, como em “A” para ā ou “T” para ṭ, evitando o uso de diacríticos. Já o sistema Velthuis utiliza combinações de caracteres, como “aa” para ā ou “.t” para ṭ, buscando uma correspondência mais explícita entre grafia e som. O ITRANS, por sua vez, introduz uma lógica de conversão bidirecional, permitindo que a transliteração em ASCII seja automaticamente transformada em dêvanágarí, o que o torna particularmente adequado para ambientes digitais e para a produção de textos eletrônicos (AVINASH CHOPDE, 1996). O sistema SLP1 adota uma abordagem ainda mais radical, estabelecendo uma correspondência unívoca entre cada fonema sânscrito e um único caractere ASCII, o que o torna extremamente eficiente para processamento computacional, embora menos intuitivo para leitura humana. O WX notation, amplamente utilizado na Índia, especialmente em aplicações de processamento de linguagem natural, segue uma lógica semelhante, priorizando a consistência interna e a facilidade de manipulação por algoritmos (BHATTA; PRASAD, 2004). Em todos esses casos, a transliteração deixa de ser pensada prioritariamente para o leitor humano e passa a ser concebida também como interface entre linguagem e máquina. Essa multiplicidade de sistemas não deve ser interpretada como uma falha de padronização, mas como consequência direta da coexistência de diferentes finalidades. Se, nos períodos anteriores, a romanização oscilava entre o rigor científico e a funcionalidade prática, a era computacional introduz um terceiro polo: a eficiência algorítmica. A precisão fonética, a legibilidade humana e a compatibilidade computacional passam a constituir três dimensões distintas, nem sempre conciliáveis em um único sistema. Cada esquema de transliteração enfatiza uma dessas dimensões, refletindo o contexto em que foi desenvolvido. Com o advento do Unicode, a partir do final do século XX, essa limitação técnica é, em grande medida, superada. Ao permitir a representação consistente de caracteres com sinais diacríticos e a inclusão de sistemas de escrita não latinos, o Unicode torna possível o uso direto tanto do IAST quanto do próprio dêvanágarí em ambientes digitais (UNICODE CONSORTIUM, 2020). Em princípio, isso poderia sugerir uma convergência em direção a um padrão único, no qual a necessidade de sistemas alternativos desapareceria. No entanto, o que se observa é o contrário: a coexistência desses sistemas não apenas persiste, mas se consolida. Isso ocorre porque os sistemas desenvolvidos durante a era ASCII não respondem apenas a limitações técnicas contingentes, mas a necessidades estruturais distintas. Mesmo em um ambiente em que o Unicode permite a representação plena dos caracteres, a facilidade de digitação, a compatibilidade com sistemas legados e a eficiência em processamento automático continuam a favorecer o uso de transliterações simplificadas em contextos específicos. A permanência de sistemas como ITRANS e Harvard-Kyoto não é, portanto, um resquício do passado, mas uma adaptação funcional a diferentes modos de uso da linguagem. Nesse cenário, normas como a ISO 15919 e sistemas como o NLK expandem os princípios do IAST para abranger não apenas o sânscrito, mas outras línguas e escritas do subcontinente indiano, consolidando um modelo de transliteração que busca equilibrar precisão fonética e aplicabilidade internacional (ISO, 2001). Ainda assim, a diversidade de sistemas permanece, refletindo a impossibilidade de reduzir a uma única solução as múltiplas funções que a linguagem desempenha no mundo contemporâneo. O que a era computacional torna evidente é que a romanização do sânscrito não é um problema que admite solução definitiva. Cada tentativa de padronização resolve um conjunto específico de questões, ao mesmo tempo em que introduz novas limitações em outros contextos. A história da transliteração, vista em seu conjunto, revela um processo contínuo de adaptação, no qual a língua é constantemente reconfigurada para responder às exigências de diferentes ambientes — rituais, acadêmicos, administrativos e, agora, digitais. Fontes: AVINASH CHOPDE.ITRANS: Transliteration Scheme for Indian Languages. 1996. BHATTA, Krishna; PRASAD, B.Natural Language Processing: A Paninian Perspective. New Delhi: Prentice-Hall of India, 2004. CERF, Vinton; KAHN, Robert.A protocol for packet network intercommunication. IEEE Transactions on Communications, 1974. GONDA, Jan.The Indian Mantra.

O Desenvolvimento da Transliteração do Sânscrito — Parte III

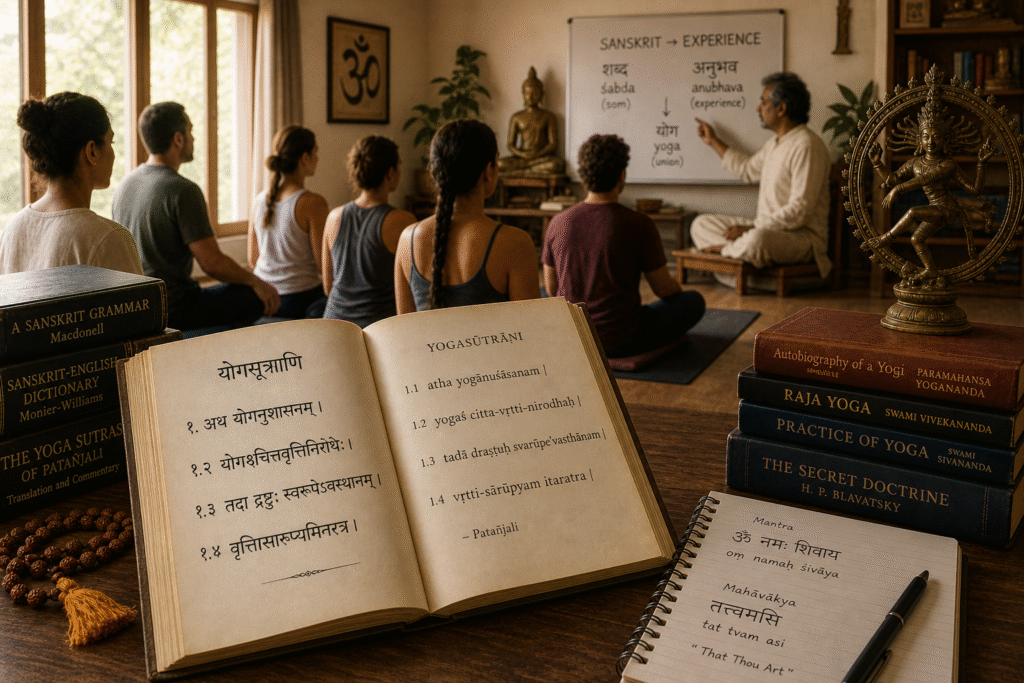

Da Filologia à Experiência: a Romanização entre Academia, Biblioteca e Tradições Esotéricas Tempo de Leitura:11 a 13 minutos Ao longo do século XX, especialmente entre as décadas de 1920 e 1970, a romanização do sânscrito entra em uma fase de consolidação que, embora menos marcada por inovações formais do que o período anterior, revela-se decisiva para sua fixação como prática internacional. Se, no século XIX, o problema central consistia em como representar adequadamente os sons do sânscrito em caracteres latinos, neste momento a questão desloca-se para um plano distinto, no qual a preocupação dominante passa a ser a estabilização, a difusão e a adaptação desses sistemas a contextos institucionais diversos. O problema deixa de ser apenas técnico e passa a envolver a circulação do conhecimento, a organização de acervos e a transformação do próprio estatuto da língua sânscrita no mundo moderno (HALBFASS, 1988; POLLOCK, 2006). No âmbito acadêmico, o sistema que viria a ser conhecido como IAST consolida-se progressivamente como padrão dominante nas publicações filológicas, nas edições críticas e nas gramáticas. Seu uso sistemático por autores como Whitney e Macdonell permite que o sânscrito seja estudado em universidades europeias e norte-americanas sem a necessidade imediata do domínio do dêvanágarí, funcionando como uma espécie de língua gráfica intermediária, que preserva com razoável precisão as distinções fonéticas da língua original ao mesmo tempo em que se torna acessível a um público formado dentro da tradição alfabética latina (MACDONELL, 1910; WHITNEY, 1889). Nesse contexto, a romanização deixa de ser uma solução provisória e passa a constituir uma infraestrutura intelectual estável, indispensável à consolidação da indologia como campo acadêmico internacional. Paralelamente a esse processo, desenvolve-se uma dimensão menos visível, mas igualmente determinante: a incorporação do sânscrito aos sistemas bibliográficos ocidentais. A expansão dos acervos, a circulação de manuscritos e a produção crescente de edições impressas exigem métodos de catalogação que permitam a identificação, organização e recuperação das obras. Nesse contexto, sistemas como o ALA-LC, desenvolvidos no âmbito da American Library Association e da Library of Congress, desempenham papel central ao estabelecer normas de transliteração que tornam possível a integração de textos em sânscrito aos catálogos internacionais (ALA-LC, 1997). A romanização, aqui, assume uma função documental: ela não apenas representa a língua, mas viabiliza o acesso ao conhecimento, operando como interface entre tradições escritas distintas e sistemas modernos de classificação. Esse movimento não pode ser dissociado das transformações políticas do período. A independência da Índia, em 1947, introduz uma nova camada de complexidade ao problema da romanização, na medida em que a padronização de nomes próprios, documentos e referências geográficas passa a assumir importância administrativa em um Estado recém-formado. O sistema associado a William Wilson Hunter, herdado do período colonial, continua a ser utilizado em larga escala, sobretudo em contextos oficiais, sendo progressivamente ajustado por meio da introdução de sinais diacríticos que aproximam sua forma das convenções acadêmicas (HUNTER, 1871; KING, 1999). A substituição do acento agudo pelo mácron para indicar o comprimento vocálico evidencia uma tentativa de conciliar simplicidade operacional e precisão fonológica, ainda que de forma parcial. A romanização torna-se, assim, instrumento de governo, articulando língua, território e administração em um contexto de reorganização política. No entanto, a transformação mais significativa desse período ocorre fora do ambiente acadêmico e administrativo. A partir das primeiras décadas do século XX, observa-se a emergência de um novo campo de circulação do sânscrito, no qual a língua deixa de ser apenas objeto de estudo e passa a ser incorporada a práticas espirituais, filosóficas e pedagógicas voltadas ao público ocidental. Esse movimento não se dá de forma homogênea, mas envolve diferentes atores e tradições, que operam com graus variados de fidelidade à estrutura original da língua. Um dos vetores iniciais desse processo encontra-se na Sociedade Teosófica, fundada por Helena Petrovna Blavatsky e posteriormente desenvolvida por Annie Besant, na qual conceitos sânscritos passam a ser mobilizados em um contexto universalista, frequentemente desvinculado das exigências filológicas que caracterizavam o campo acadêmico (BLAVATSKY, 1888; BESANT, 1905). Termos como karma, ātman e mantra são incorporados a um vocabulário espiritual global, no qual a precisão fonética e a correspondência rigorosa com o original deixam de ser prioritárias. A romanização, nesse contexto, assume uma função pragmática: tornar pronunciáveis e reconhecíveis palavras que passam a circular fora de seu ambiente linguístico originário. Esse processo é aprofundado pela atuação de Swami Vivekananda, cuja apresentação do Vedānta ao público ocidental contribui decisivamente para a difusão de termos sânscritos em contextos filosóficos e religiosos mais amplos (VIVEKANANDA, 1896). Ao deslocar o foco da erudição para a experiência, Vivekananda introduz uma nova forma de relação com o sânscrito, na qual a linguagem não é apenas analisada, mas vivida. A romanização passa a desempenhar um papel intermediário entre o texto e a prática, permitindo que conceitos complexos sejam transmitidos a um público que não domina as estruturas fonéticas da língua original. Na sequência, ao longo da primeira metade do século XX, a difusão do Yôga por figuras como Paramahansa Yogananda e, posteriormente, por Swami Sivananda e seus discípulos, amplia esse movimento, consolidando o uso do sânscrito em contextos pedagógicos e práticos (YOGANANDA, 1946; SIVANANDA, 1935). Nesse ambiente, a romanização sofre uma inflexão decisiva: enquanto o meio acadêmico busca preservar as distinções fonéticas por meio de sistemas diacríticos rigorosos, os contextos de ensino e prática privilegiam formas mais acessíveis, capazes de orientar a pronúncia de maneira intuitiva. Grafias como “Shiva”, “Yoga” e “Atman” tornam-se predominantes não por sua precisão, mas por sua eficácia comunicativa. Essa diferença não deve ser interpretada como erro ou degradação, mas como adaptação funcional a contextos distintos. O que se observa é a emergência de duas lógicas paralelas de romanização: uma voltada à análise científica da língua, outra à sua transmissão prática. A primeira exige precisão, estabilidade e correspondência sistemática; a segunda privilegia legibilidade, memorização e aplicabilidade. Ambas operam sobre o mesmo objeto, mas respondem a finalidades diferentes. É justamente essa duplicidade que explica a persistência de múltiplos sistemas de transliteração ao longo do século XX. Longe de convergir para uma única solução, a romanização do